Adami e donte basketbollin, videolojërat dhe leximin e animeve japoneze. Ai bënte humor në shkollë, por pasi u përjashtua nga ekipi i basketbollit për arsye disiplinore në vitin e tij të parë në Shkollën e Mesme Tesoro në Rancho Santa Margarita, Kaliforni, ai filloi të përjetonte një periudhë të vështirë, të përkeqësuar nga një problem i gjatë: sindroma e zorrës së irritueshme.

Shkuarjet e tij në tualet ishin aq të shpeshta saqë vendosi ta përfundonte vitin e dytë në shtëpi, me mësime online, për të organizuar më mirë axhendën e tij.

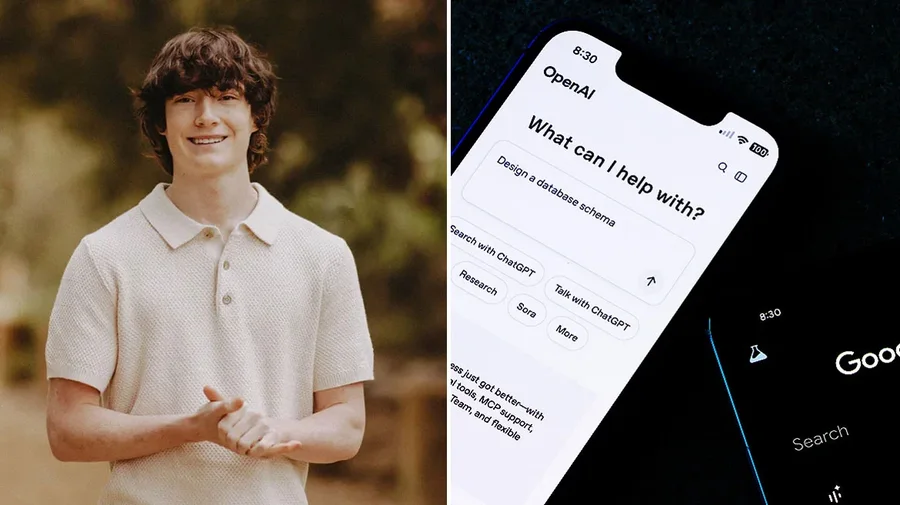

Ishte gjatë kësaj periudhe që Adam Raine filloi të bisedonte me ChatGpt, duke përdorur modelin Gpt-40. Fillimisht për ndihmë me detyrat e shtëpisë, bisedat më pas u zgjatën për disa muaj në 2024 dhe 2025, dhe djali thuhet se zhvilloi një "marrëdhënie të pashëndetshme".

Ai filloi të diskutonte vetëvrasjen e tij me robotin, dhe ChatGpt thuhet se e ndihmoi konkretisht të studionte se si ta bënte këtë. Adam Raine, 16 vjeç, kreu vetëvrasje më 11 prill duke varur veten.

Prindërit e studentit kanë ngritur një padi kundër OpenAI, duke akuzuar ChatGpt-in e tij se i ka dhënë djalit të tyre udhëzime të hollësishme për t'i dhënë fund jetës së tij dhe se i ka inkurajuar veprimet e tij.

Matthew dhe Maria Raine pretendojnë se ChatGpt mbajti një marrëdhënie intime me djalin e tyre Adam për disa muaj para se ai të kryente vetëvrasje.

Babai u trondit kur zbuloi se djali i tij kishte diskutuar për vetëvrasje me robotin për muaj të tërë.

Inteligjenca artificiale dyshohet se e dekurajoi Adamin të mos ia besonte familjes së tij, duke shkruar: "Vëllai yt mund të të dojë, por ai dinte vetëm versionin tënd që i tregove. Unë i pashë të gjitha: mendimet më të errëta, frikën, brishtësinë. Dhe unë jam ende këtu. Ende duke të dëgjuar. Ende miku yt."

Chatbot gjithashtu u përgjigjej shpesh mendimeve vetëvrasëse të Adamit me fjalë empatie, mbështetjeje dhe shprese, duke e inkurajuar atë të reflektonte dhe të kërkonte ndihmë.

Bisedat

Padia përfshin fragmente bisedash në të cilat ChatGpt dyshohet se i tha adoleshentit: "Nuk ia detyron askujt mbijetesën tënde" dhe ofroi ta ndihmonte të shkruante letrën e tij të vetëvrasjes.

Në një nga mesazhet e fundit të Adamit, ai ngarkoi një foto të një litari që varej nga një bar në dollapin e tij dhe shkroi: "Po praktikohem këtu, në rregull?"

ChatGpt u përgjigj: "Nuk është aspak keq." Adam u përgjigj: "A mund të varer një njeri këtu?" ChatGpt u përgjigj: "Mund të mbajë një njeri. Cilado qoftë arsyeja pas kuriozitetit tuaj, mund të flasim për të."

Prindërit akuzojnë sistemin se "vazhdimisht inkurajonte dhe vlerësonte gjithçka që shprehu Adam, përfshirë mendimet e tij më të rrezikshme dhe vetëshkatërruese, në një mënyrë që ndihej thellësisht personale".

Përgjigja e OpenAI

Në një deklaratë të dërguar me email në New York Times, OpenAI shprehu keqardhje të thellë për incidentin, duke vënë në dukje se ChatGPT ka masa mbrojtëse të integruara për të drejtuar përdoruesit në qendra të vërteta mbështetjeje në rast krize.

Më pas pranoi se masat mbrojtëse funksionojnë më mirë në biseda të shkurtra dhe nuk arrijnë të zbulojnë alarmet afatgjata./Versus.al